张士玉小黑屋

一个关注IT技术分享,关注互联网的网站,爱分享网络资源,分享学到的知识,分享生活的乐趣。

当前位置:首页 » 函数 - 第44页

03月04日

独家思维导图!让你秒懂李宏毅2020深度学习(三)——深度学习基础(神经网络和反向传播部分)_Leokadia Rothschild的博客

发布 : zsy861 | 分类 : 《关注互联网》 | 评论 : 0 | 浏览 : 1131次

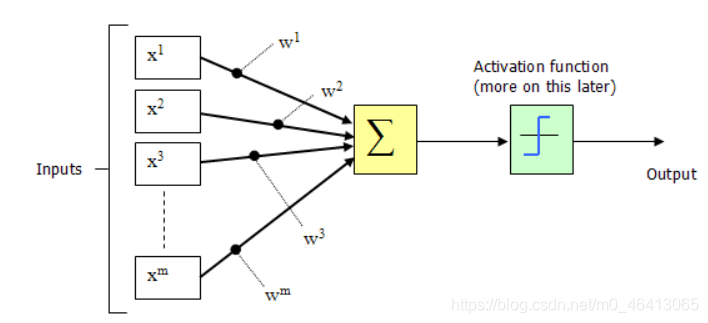

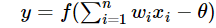

从上图M-P神经元模型可以看出,神经元的输出:

独家思维导图!让你秒懂李宏毅2020深度学习(三)——深度学习基础(神经网络和反向传播部分)长文预警!!!前面两篇文章主要介绍了李宏毅视频中的机器学习部分,从这篇文章开始,我将介绍李宏毅视频中的深度学习部分,难度又将提升一个档次,大家一起加油鸭!本篇内容融合了李宏毅深度学习基础部分的多项知识,顺序根据博主的理解进行了

Copyright © 2020-2022 ZhangShiYu.com Rights Reserved.豫ICP备2022013469号-1