search papers and group them

检索工具

-

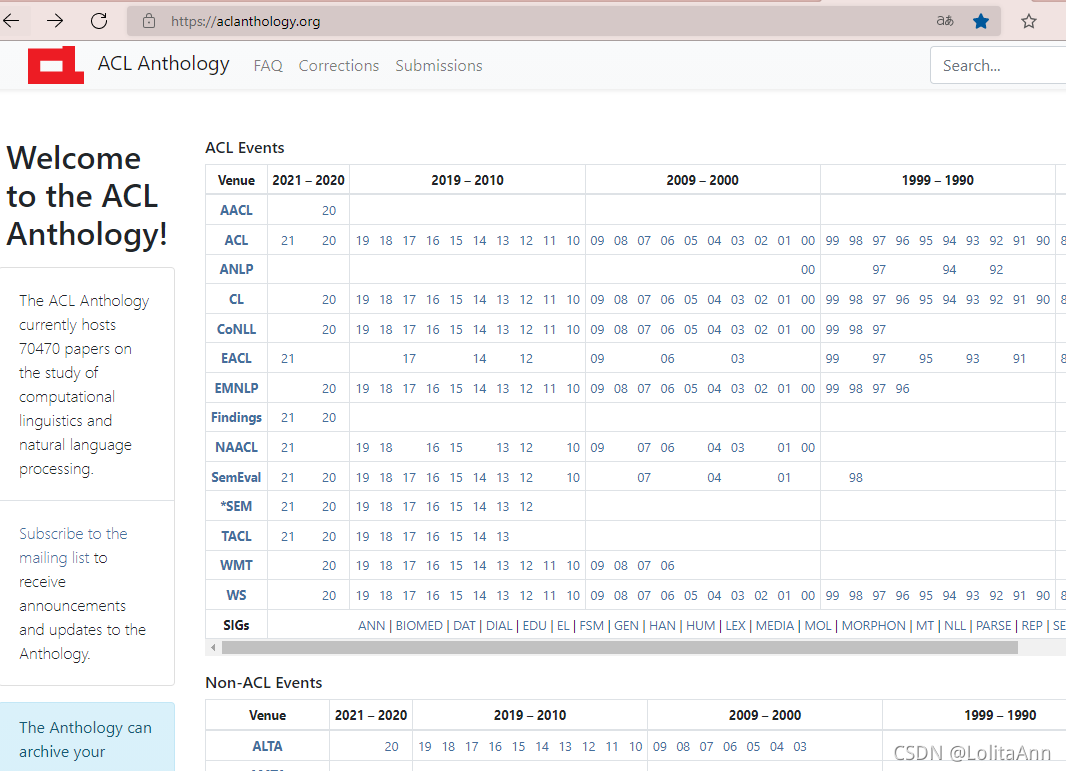

ACL Anthology

各种会议文章集合,连会议带年份。进去搜索自己需要的关键词即可。

当然会有延迟。并不是会议出来就直接能看到。 -

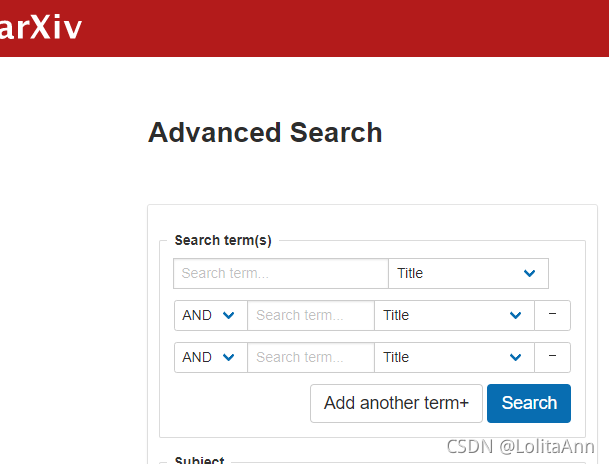

限定文献检索:arXiv

arXiv是由康奈尔大学运营维护的一个非盈利的数据库,由于免费,学术研究人员可以在其他顶会或者期刊没有录用之前,将自己最新的研究成果发布到该平台上,一方面是为了扩大宣传提升自己的影响力;另外一方面是为了保护自己的科研成果,因为无论会议和期刊从投出到最终可以检索,都需要长时间的等待,很难保证期间自己成果不被别人剽窃,arXiv可以证明论文的原创性。

-

知网啊谷歌学术啊这些常用的一般都用不到了,因为ACL已经收录的比较完美了。

组织方法

通过一些方法讲文章分类组织起来。

- By conferences 通过会议

- By preprint or not 在arxiv是否发表

需要及时更新,因为arxiv上预发表的文章你可以引用,但是文章中了以后你需要引用它具体出自哪里。所以arxiv上的文章需要定期更新。 - By problems 根据问题

- By methods(models) 根据方法

初学者可以这样分- CNN

- RNN

- GNN

- Transformer

- Attention

- Reinforcement

- ……

- By dataset(text type) 根据数据集

- DUC

- LCSTS

- CNN/Daily

- ……

- By optimize methods(depends on your own idea)

select the better paper

- conference

多看会议文章,少看期刊文章。会议文章比较新。- NLP domain

- ACL

- COLING

- EMNLP

- NAACL

- General AI

- AAAI

- IJCAI

- NIPS

- ICLR

- Chinese NLP

- NLPCC

- CCKS

- CCIR

- NLP domain

- relation

跟你做的方向最最最相关的,不要什么都看,就算看也不要精读。没精力做那么多的。 - citation

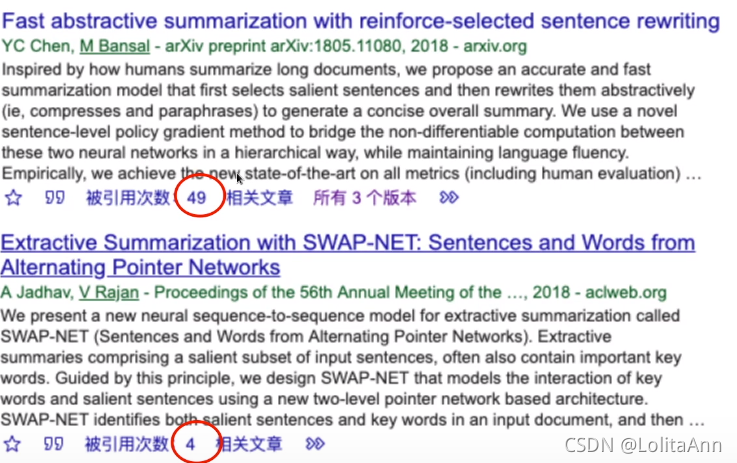

引用数量啊,肯定是引用数量越多质量肯定会好一点啊。

下图虽然两个文章都是顶会,但是优先看引用数量比较多的啊。

- influence

论文看多了以后会发现每年的论文都是这几个大组做的,找到这几个大佬之后,以后可以集中看他们写的。 - code

有没有代码开源。判断是不是ppt项目,最好选有代码的paper。

the reading order you should follow

不要只看题目标题啊!!!

- abstract

- subarea

- problems

- proposal/method

- Datasets

- performance

- introduction

回顾前人成果,提出自己想解决的问题 - experiment + conclusion

实验和成果 - proposal

要精读的时候再看方法- 看图

- 看创新性

- 看公式

write down the notes

- From(Conferences/Journals/ArXiv)

- Institution

- Paper

- Topic

- Aim

- Problem to solve

- Solutions

- Strengths

- Limitations

- Datasets

- Evaluation scores

- Code

presentation

珍惜每一次汇报工作!!!

安利

fastNLP 中文文档,复现一些代码。