目录

一、深度强化学习概述(DRL)

(一)概述

1、DRL可以获得复杂网络优化的解决方案

2、DRL允许网络实体学习和构建有关通信和网络环境的知识

3、DRL提供自主决策

4、DRL显著提高了学习速度,特别是在具有大状态和大动作空间的问题中

5、通信和网络中的其他几个问题,如网络物理攻击、干扰管理和数据卸载,可以建模为游戏

(二)强化学习(Reinforcement Learning,简称RL)

1.1基本概念

1.2RL基本元素(第一层结构)

1.3RL主要元素(第二层结构)

1.4RL核心元素(第三层结构)

1.5强化学习两个特点与一个核心

1.5.1两个特点

1.5.1.1、试错(trial and error)

1.5.1.2、延迟奖励(Delayed Reward)

1.5.2一个核心

二、马尔可夫链(Markov Chain, MC)

组成部分

特性

三、马尔科夫决策过程(Markov Decision Process, MDP)

1、典型的马尔科夫过程建模(MDP)

2、部分可观测马尔科夫决策过程(Partially Observable Markov Decision Process,POMDP):

3、对比MDP与POMDP:

三、总结

1、与Markov相关的四个概念

2、MDP和POMDP与深度强化学习DRL/强化学习RL间的关系

一、深度强化学习概述(DRL)

(一)概述

现代网络规模大、结构复杂,计算复杂度很快变得难以控制。因此,DRL一直在发展成为克服这一挑战的替代解决方案。一般来说,DRL方法提供以下优点:

1、DRL可以获得复杂网络优化的解决方案

因此,它使现代网络中的网络控制器,如基站,在没有完整准确的网络信息的情况下,解决联合用户关联、计算、传输调度等非凸复杂问题,达到最优解。

2、DRL允许网络实体学习和构建有关通信和网络环境的知识

因此,通过使用DRL,网络实体(例如移动用户)可以在不知道信道模型和移动模式的情况下学习最优策略,例如基站选择、信道选择、切换决策、缓存和卸载决策

3、DRL提供自主决策

使用DRL方法,网络实体可以在最小或不需要相互交换信息的情况下局部观察并获得最佳策略。这不仅减少了通信开销,而且提高了网络的安全性和健壮性。

4、DRL显著提高了学习速度,特别是在具有大状态和大动作空间的问题中

因此,在大型网络中,例如拥有数千台设备的物联网系统,DRL允许网络控制器或物联网网关动态控制大量物联网设备和移动用户的用户关联、频谱接入和传输功率

5、通信和网络中的其他几个问题,如网络物理攻击、干扰管理和数据卸载,可以建模为游戏

例如,非合作游戏。DRL最近被用作解决博弈的有效工具,例如,在没有完整信息的情况下找到纳什均衡

(二)强化学习(Reinforcement Learning,简称RL)

1.1基本概念

RL属于是机器学习的一个分支, 通过智能体agent与环境的交互学习最优策略解决问题. 在RL中, agent与环境env交互, 通过观察环境的状态state, 采取特定的动作action, 并从环境中获取奖励reward和惩罚penalty.

且agent的目标是通过与env的交互, 学习出使得累计奖励return最大化的最优策略.

1.2RL基本元素(第一层结构)

1、智能体(agent):agent是RL系统决策的主体, 可以是一个机器学习ML算法, 机器人或其他人工智能实体; agent通过与env交互来学习和改进自己的策略.

2、环境(env):环境是agent所处的外部世界, 可以是真正的物理环境、虚拟环境或模拟器; env可以对agent的action做出响应, 提供反馈信息(奖励或惩罚)和更新状态.

3、目标(goal):目标是RL的最终目标或人物, agent需要通过学习和策略来达到或优化目标; 目标可以是预定义的, 也可以是agent与env的交互动态设定的.

1.3RL主要元素(第二层结构)

1.状态(State)

表示env在某一时刻的特定情况或特征,如机器人的坐标, 敌人的坐标等; 且state可以是离散的(迷宫中位置)或连续的(如机器人的传感器读数).

2.动作(Action)

action是agent基于当前状态state所选的行为或决策. 且动作可以是连续的(机器人的速度控制)或离散的(如向左向右移动).

3.奖励(reward)

奖励reward是环境提供给agent的即时反馈, 用于评估agent的action.

1.4RL核心元素(第三层结构)

1、策略(policy)

在数学中, 可以把策略表示为一个函数pi, 输入当前状态state, 然后输出对应的动作action. 故强化学习RL需要达到的目的就是学习到一个好的策略pi.

2、价值(value)

价值也同样是一个函数, 且策略函数就取决于价值函数. 价值指的是与其将来会得到的奖励reward之和.

1.5强化学习两个特点与一个核心

1.5.1两个特点

1.5.1.1、试错(trial and error)

即RL是一种试错学习, 也就是在不断的尝试中学习。

1.5.1.2、延迟奖励(Delayed Reward)

另一个特点是延迟奖励, 行动没有对应的即时的奖励, 但是每一步棋对于最后的胜利都是有贡献的, 这就导致一个行动可能没有奖励reward, 但是它一定有价值, 不过一个行动的价值, 只有在得到了奖励reward后才能真正得到体现, 而这个reward可能会发生在一段时间之后, 在玩家采取了很多其它的行动之后, 这就称为延迟奖励delayed reward.

在实际得到奖励reward之后, 我们知道以前所采取的行动都对这个奖励reward有贡献, 那么如何学习过去的行动action所具有的价值, 这就涉及到一个Credit Assignment和Backpropagation的问题.

1.5.2一个核心

在经典的RL中有一个核心的问题即Exploration探索 and Exploitation利用.

Exploitation指的是利用, 通过利用RL所学习到的价值函数, 一个极端的例子就是我们有了状态动作价值函数之后, 想当然的应该选择价值最高的对应的动作action.Exploration指的是探索, 即探索新的动作action, 从而探索新的情况, 这可能会带来更好的结果.综上, Exploration and Exploitation之间的权衡是RL中的一个核心问题. 如果仅在环境中选择利用, 那么如果仍然按照选取最大价值对应的动作, 那么有可能学习到的不是最优策略, 也就是说该价值对应的动作不一定是最优的; 相反, 有一些对应价值不是最高的动作action, 有可能其实际的价值很高.所以, 我们不仅要利用已有的价值函数, 还应该尝试探索不同的动作从而优化价值函数.

一种比较合理的结合利用与探索的方式应该是:在初始阶段时, agent在与环境的交互非常有用, 可以加深agent对于env的理解; 在逐渐趋于稳定时, 也就是说对于env已经有了一定得了解, 这种情况下采取利用是比较好的, 选择价值函数最大的.

在正式引入马尔可夫链, 马尔可夫决策过程以及部分可观测性马尔科夫决策过程之前, 先引入马尔可夫性, 他们的核心都是马尔可夫性.

所谓的马尔可夫性指的是未来的状态仅依赖于当前状态, 而与过去的状态无关, 换句话说, 如果给定当前状态, 过去的信息对未来的预测是没有额外的价值. 也可以把上述特性称为无后效性.

二、马尔可夫链(Markov Chain, MC)

马尔科夫链是一种随机过程, 描述了在某个状态下的系统如何转移到另一个状态, 核心特性是马尔可夫性, 即未来的状态仅依赖于当前状态, 而与过去的状态无关.

组成部分

状态空间S:代表所有可能的状态的集合,  .

.

转移概率:指的是从一个状态转移到另一个状态的概率, 通常可表示为 , 表示在t时刻的状态只依赖于t-1时刻的状态.

, 表示在t时刻的状态只依赖于t-1时刻的状态.

初始分布:描述的是系统在初始时刻处于各状态的概率分布.

特性

无记忆性:当前状态完全决定未来状态的分布.

平稳性:如果转移概率不随时间变化, 则称为平稳马尔可夫链.

三、马尔科夫决策过程(Markov Decision Process, MDP)

MDP是一个离散的时间随机控制过程。MDP为决策问题的建模提供了一个数学框架,在这些问题中,结果是随机的,并且受决策者或代理的控制. MDP对于研究可以通过动态规划和强化学习技术解决的优化问题是有用的. MDP相比于MC则是加入了智能体agent作为决策者和奖励机制reward. 相对来讲, MDP和POMDP比较适合于单智能体(single-agent)系统, 而对于多智能体(multi-agent)系统来说, 仅依靠MDP和POMDP可能是不够的, 因为多智能体系统一般都是多个智能体间可能会存在着相互作用.

1、典型的马尔科夫过程建模(MDP)

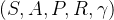

首先,MDP被定义为一个元组 。其中,S是状态的有限集合,A是动作的有限集合,P是指在动作a

。其中,S是状态的有限集合,A是动作的有限集合,P是指在动作a 执行后从状态s到状态s'的转移概率,并且r是执行动作a之后获得的即时奖励.

执行后从状态s到状态s'的转移概率,并且r是执行动作a之后获得的即时奖励.

我们将 表示为一个策略,它是一个从状态到动作的映射。MDP的目标是找到一个使奖励函数最大化的最优策略。MDP可以是有限或无限的时间范围。对于有限时间范围MDP,使得期望总汇报最大化的最优策略

表示为一个策略,它是一个从状态到动作的映射。MDP的目标是找到一个使奖励函数最大化的最优策略。MDP可以是有限或无限的时间范围。对于有限时间范围MDP,使得期望总汇报最大化的最优策略 由

由![]() 定义,其中,

定义,其中, ,指的就是策略在st下选择动作at。对于无限时间范围MDP,目标可以是最大化预期的折扣总奖励或最大化平均奖励。折扣总奖励被定义为

,指的就是策略在st下选择动作at。对于无限时间范围MDP,目标可以是最大化预期的折扣总奖励或最大化平均奖励。折扣总奖励被定义为![]() ,平均奖励被定义为

,平均奖励被定义为![]() 。其中

。其中![\gamma \epsilon [0,1]](http://zhangshiyu.com/zb_users/upload/2024/10/20241017180115172915927590355.png) 表示的是折扣率,折现系数γ决定了未来奖励相比于当前奖励的重要性。

表示的是折扣率,折现系数γ决定了未来奖励相比于当前奖励的重要性。当

时,智能体只考虑当前利益,即最大化即时的奖励;相反,若

时,智能体只考虑当前利益,即最大化即时的奖励;相反,若 接近于1,智能体/代理agent将会争取长期更高的奖励.

接近于1,智能体/代理agent将会争取长期更高的奖励.

2、部分可观测马尔科夫决策过程(Partially Observable Markov Decision Process,POMDP):

在MDP中,我们假设系统状态是被agent完全观察到的。然而,在许多情况,智能体agent仅能观察到系统状态的一部分,因此因此,部分可观察马尔可夫决策过程(POMDPs)可用于建模决策问题。

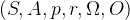

一个典型的POMDP模型可以被定义为六元组 ,其中,元组中的前面四个元素可以看到,与基本的MDP模型所代表的含义相同。这其中的

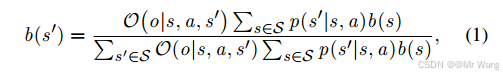

,其中,元组中的前面四个元素可以看到,与基本的MDP模型所代表的含义相同。这其中的 和O分别表示观测集合和观测概率。在每个时间点(at each time epoch),agent智能体处于状态s,基于它对当前状态s的信念b(s)选择一个动作a,并观察即时奖励r和当前观察值o。基于观察值o和它对当前状态的信念b(s),然后智能体更新关于新状态s'的信念b(s'),如下所示(as follows):

和O分别表示观测集合和观测概率。在每个时间点(at each time epoch),agent智能体处于状态s,基于它对当前状态s的信念b(s)选择一个动作a,并观察即时奖励r和当前观察值o。基于观察值o和它对当前状态的信念b(s),然后智能体更新关于新状态s'的信念b(s'),如下所示(as follows):

其中,O(o|s,a,s')指的是agent在状态s下采取动作a获得观测o的概率以及agent移动到状态s'。p(s'|s,a)的定义与MDP相同,表示在状态s下执行动作a从状态s到状态s'的转移概率。最后,agent获得的即时奖励r等于MDp中的r(s,a)。与MDP模型相类似,POMDP中的智能体也以寻找最优策略 为目标,以最大化它的预期长期贴现奖励

为目标,以最大化它的预期长期贴现奖励![]()

3、对比MDP与POMDP:

在下图fig3中,主要强调对比了MDP和POMDP模型.

对于MDP模型来说,当前智能体需要观测状态st,然后根据策略 /值函数(V/Q函数)选出最优的动作并执行,此时会反馈一个即时的奖励rt,并且会进入到下一时刻的状态st+1。

/值函数(V/Q函数)选出最优的动作并执行,此时会反馈一个即时的奖励rt,并且会进入到下一时刻的状态st+1。

对于POMDP模型来说,引入了观测空间O。由于在POMDP模型中,智能体无法直接观察到环境的状态,而是通过观察到的部分信息来推断环境的状态。观测到的信息可以是不完全的、模糊的,又或者是有噪声的,这就使得智能体需要在不完全信息的情况下做出决策.

三、总结

1、与Markov相关的四个概念

马尔科夫链(Markov Chain)、马尔科夫决策过程(Markov Decision Process,MDP)、部分可观察马尔科夫决策过程(Partially Obserable Markov Decision Process,POMDP)、隐马尔科夫模型(HMM)。

2、MDP和POMDP与深度强化学习DRL/强化学习RL间的关系

MDP和POMDP都是一种数学模型,它是现实中一部分问题的抽象表达形式;而深度强化学习则是一种利用深度学习技术解决强化学习问题的方法;强化学习是一种机器学习范式,旨在让智能体agent通过与环境的交互学习如何做出决策,以最大化长期奖励。

由此可见,MDP和POMDP都提供了强化学习问题的数学框架,而DRL是一种利用深度学习技术解决这些问题的方法,DRL可以应用于MDP和POMDP的求解,为解决复杂的问题提供了一种有效的途径。

参考文献

[1] Applications of Deep Reinforcement Learning in Communications and Networking: A Survey.

[2] 11. 深度学习——强化学习 - 牛客网.