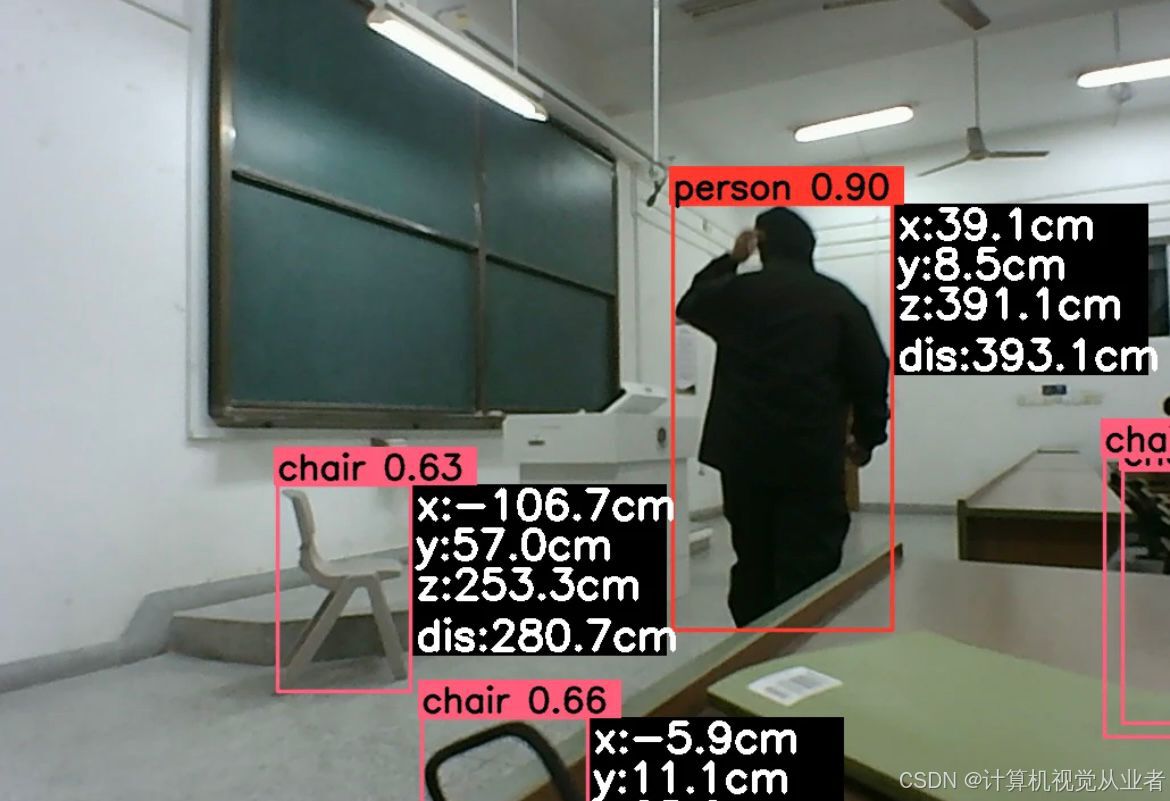

YOLOv8:YOLOv8 是一个目标检测模型,它是 YOLO(You Only Look Once)系列的一部分,用于实时物体检测。YOLOv8 能够快速准确地检测视频或图像中的对象。

双目测距:双目测距是指使用两个摄像头(或一个立体相机)从不同角度拍摄同一场景,通过比较两个摄像头捕捉到的图像差异来计算物体的距离。这里提到的 SGBM(Semi-Global Block Matching)算法是一种常用的双目匹配算法,用于计算视差图,进而得到深度图。

前端源码和无前端源码:前端源码通常指的是用于用户界面的部分,可能包括用于显示实时视频流、检测结果、测距结果等的图形用户界面(GUI)。无前端源码则仅包含后端处理逻辑,不包含任何用户界面部分。

SGBM 双目测距算法:SGBM 算法用于计算两个摄像头捕捉到的图像之间的视差图。视差图反映了物体相对于摄像头的距离,距离越近的物体,视差越大;距离越远的物体,视差越小。

视差图和深度图:视差图是通过 SGBM 算法计算出来的,它表示每个像素点在两个摄像头中的位置差异。深度图则是从视差图计算得出的,它表示每个像素点对应的实际距离。

极线矫正:在双目视觉系统中,极线矫正(Epipolar Geometry Correction)是一种技术,用于确保两个摄像头捕捉到的图像在同一水平线上,这有助于简化后续的视差计算过程。

项目概述

这个项目可能包括以下几个组成部分:

YOLOv8 模块:负责检测视频或图像中的目标。SGBM 算法模块:用于计算视差图,进而得到深度图。极线矫正模块:用于对齐两个摄像头的图像,简化视差计算。前端模块(可选):提供用户界面,用于显示视频流、检测结果和测距结果等。后端模块:处理视频流,执行目标检测和双目测距。使用场景

安防监控:通过检测和测量人员或物体的距离,可以提高监控系统的智能化水平。自动驾驶:用于识别道路上的障碍物及其距离,辅助车辆的导航和避障。人机交互:通过检测人体姿势和距离,可以实现更加自然的交互方式。技术要点

环境准备

首先,确保安装了必要的库,如OpenCV、PyTorch等。可以使用以下命令安装:

pip install opencv-python-headless torch torchvision1. 加载YOLOv8模型

加载YOLOv8模型并进行目标检测。

import cv2import torchdef load_yolov8_model(model_path): model = torch.hub.load('ultralytics/yolov5', 'custom', path=model_path) return modeldef detect_objects(frame, model): results = model(frame) boxes = results.xyxy[0].numpy() return boxes2. 双目图像读取与预处理

读取双目摄像头的图像,并进行预处理。

def read_stereo_images(left_camera, right_camera): left_frame, _ = left_camera.read() right_frame, _ = right_camera.read() # 转换为灰度图像 left_gray = cv2.cvtColor(left_frame, cv2.COLOR_BGR2GRAY) right_gray = cv2.cvtColor(right_frame, cv2.COLOR_BGR2GRAY) return left_gray, right_gray3. 极线矫正

使用OpenCV进行极线矫正。

def stereo_rectify(left_gray, right_gray, calibration_params): # 根据标定参数进行极线矫正 R1, R2, P1, P2, Q, _, _ = cv2.stereoRectify( calibration_params['camera_matrix_left'], calibration_params['dist_coeffs_left'], calibration_params['camera_matrix_right'], calibration_params['dist_coeffs_right'], calibration_params['image_size'], calibration_params['R'], calibration_params['T'] ) map1x, map1y = cv2.initUndistortRectifyMap( calibration_params['camera_matrix_left'], calibration_params['dist_coeffs_left'], R1, P1, calibration_params['image_size'], cv2.CV_16SC2 ) map2x, map2y = cv2.initUndistortRectifyMap( calibration_params['camera_matrix_right'], calibration_params['dist_coeffs_right'], R2, P2, calibration_params['image_size'], cv2.CV_16SC2 ) left_rectified = cv2.remap(left_gray, map1x, map1y, cv2.INTER_LANCZOS4) right_rectified = cv2.remap(right_gray, map2x, map2y, cv2.INTER_LANCZOS4) return left_rectified, right_rectified4. SGBM双目测距

使用SGBM算法计算视差图和深度图。

def calculate_disparity(left_rectified, right_rectified): # 创建SGBM对象 stereo = cv2.StereoSGBM_create( minDisparity=0, numDisparities=160, # 必须是16的倍数 blockSize=15, uniquenessRatio=1, speckleWindowSize=100, speckleRange=32, disp12MaxDiff=1 ) # 计算视差图 disparity = stereo.compute(left_rectified, right_rectified).astype(np.float32) / 16.0 return disparitydef calculate_depth(disparity, baseline, focal_length): # 计算深度图 depth = (baseline * focal_length) / disparity return depth5. 主函数

将以上组件整合在一起。

这个项目涉及的技术相对复杂,需要一定的编程基础和对相关算法的理解。