过年不再被逼相亲——我用python给亲戚展示2022的相亲数据

人生苦短 我用Python

这不是快过年了吗?

又到了一年一度的亲戚大考验环节…

没对象的他们会问你,找对象了吗?

你要是学计算机专业的,他们会问你,会修电脑吗?

出去学了点啥他们也会要求“才艺展示一下

我相信大家都躲不过去

既然躲不过去,那直接上猛药给亲戚吓一跳吧

用python直接来采集一波相亲网站,并做数据分析

又给亲戚露一手,又向他们表达了自己单着是客观不可抗力

这波,啊这波,我看谁还敢催我找对象???

环境开发:

Python 3.8Pycharm模块使用:

import parsel --> pip install parsel import requests --> pip install requests import csv import re思路流程:

一. 数据来源分析:

1. 明确需求:

采集数据是什么 —> 资料数据 <静态网页>

都是在网页源代码里面

二. 代码实现步骤:

1.发送请求,模拟浏览器对于url地址发送请求

2.获取数据,获取服务器返回响应数据

3.解析数据,提取我们想要数据内容

4.保存数据,把数据内容保存本地

开始代码:导入数据请求模块

源码、资料电子书点击这里

import requests# 导入数据解析模块import parsel# 导入csvimport csv# 导入正则import ref = open('data.csv', mode='a', encoding='utf-8', newline='')csv_writer = csv.DictWriter(f, fieldnames=['昵称', '性别', '年龄', '身高', '体重', '出生日期', '生肖', '星座', '籍贯', '所在地', '学历', '婚姻状况', '职业', '年收入', '住房', '车辆', '照片', '详情页', ])csv_writer.writeheader()

都是一些公开数据

1. 发送请求, 模拟浏览器对于url地址发送请求

模拟浏览器 headers 请求头

可以在开发者工具里面复制粘贴的

防止被反爬

<Response [200]> 响应对象

200状态码 表示请求成功

for page in range(1, 11): # 伪装模拟 headers = { # User-Agent 用户代理, 表示浏览器基本信息 'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/101.0.0.0 Safari/537.36' }发送请求

response = requests.get(url=url, headers=headers) print(response)2. 获取数据, 获取服务器返回响应数据

开发者工具 —> response

response.json() 获取响应json数据, 字典数据类型

3. 解析数据, 提取我们想要数据内容

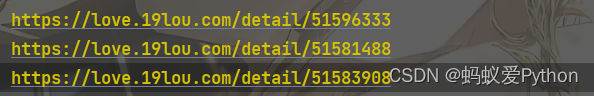

详情页ID —> UID

因为得到数据: 字典数据类型

所以解析数据: 键值对取值 —> 根据冒号左边的内容[键], 提取冒号右边的内容[值]

# for循环遍历, 把列表里面元素一个一个提取出来 for index in response.json()['data']['items']: # https://love.19lou.com/detail/51593564 format 字符串格式化方法 link = f'https://love.19lou.com/detail/{index["uid"]}'4. 发送请求, 模拟浏览器对于url地址发送请求

资料详情页url地址

5. 获取数据, 获取服务器返回响应数据

网页源代码

response.text 获取响应文本数据, 返回字符串数据类型

response.json() 获取响应json数据, 字典数据类型

html_data = requests.get(url=link, headers=headers).text6. 解析数据, 提取我们想要数据内容

基本资料信息

css选择器: 根据标签属性内容提取数据

xpath: 根据标签节点提取数据

re正则

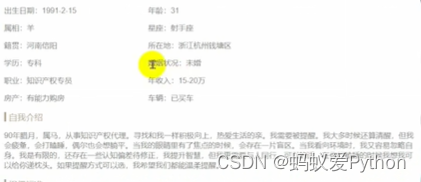

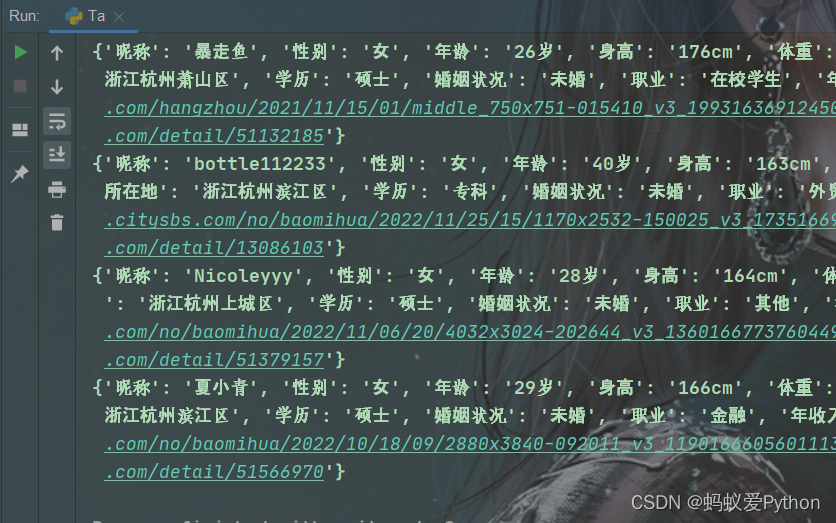

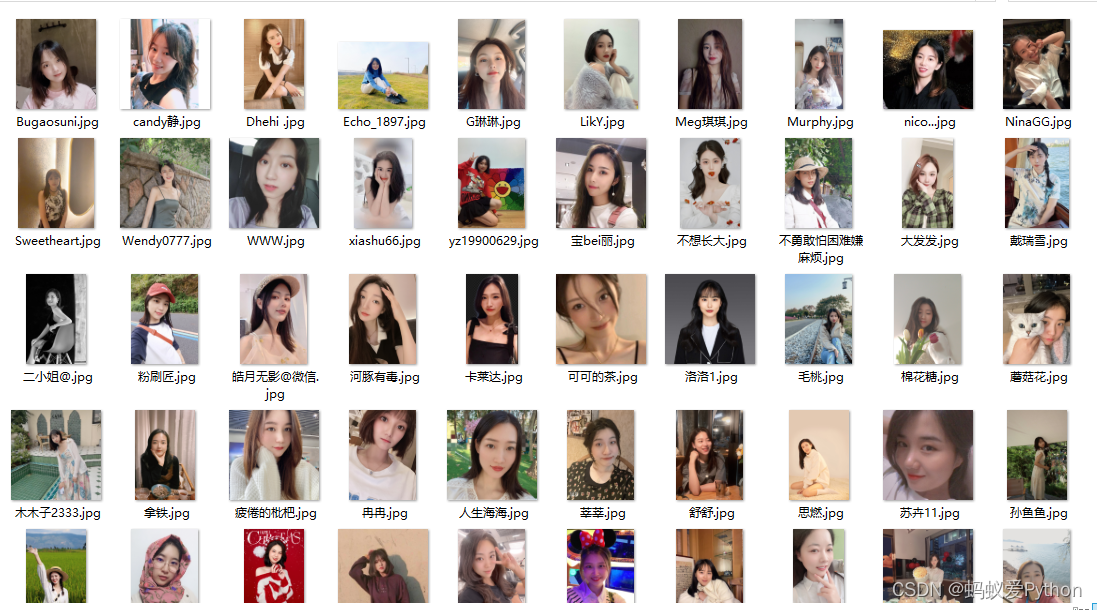

# 把获取下来 html字符串数据<html_data>, 转成可解析对象 selector = parsel.Selector(html_data) name = selector.css('.username::text').get() info_list = selector.css('.info-tag::text').getall() # . 表示调用方法属性 gender = info_list[0].split(':')[-1] age = info_list[1].split(':')[-1] height = info_list[2].split(':')[-1] date = info_list[-1].split(':')[-1] # 判断info_list元素个数 当元素个数4个 说明没有体重一栏 if len(info_list) == 4: weight = '0kg' else: weight = info_list[3].split(':')[-1] info_list_1 = selector.css('.basic-item span::text').getall()[2:] zodiac = info_list_1[0].split(':')[-1] constellation = info_list_1[1].split(':')[-1] nativePlace = info_list_1[2].split(':')[-1] location = info_list_1[3].split(':')[-1] edu = info_list_1[4].split(':')[-1] maritalStatus = info_list_1[5].split(':')[-1] job = info_list_1[6].split(':')[-1] money = info_list_1[7].split(':')[-1] house = info_list_1[8].split(':')[-1] car = info_list_1[9].split(':')[-1] img_url = selector.css('.page .left-detail .abstract .avatar img::attr(src)').get() # 把获取下来的数据 保存字典里面 字典数据容器 dit = { '昵称': name, '性别': gender, '年龄': age, '身高': height, '体重': weight, '出生日期': date, '生肖': zodiac, '星座': constellation, '籍贯': nativePlace, '所在地': location, '学历': edu, '婚姻状况': maritalStatus, '职业': job, '年收入': money, '住房': house, '车辆': car, '照片': img_url, '详情页': link, } csv_writer.writerow(dit) new_name = re.sub(r'[\/"*?<>|]', '', name)保存图片, 获取图片二进制数据

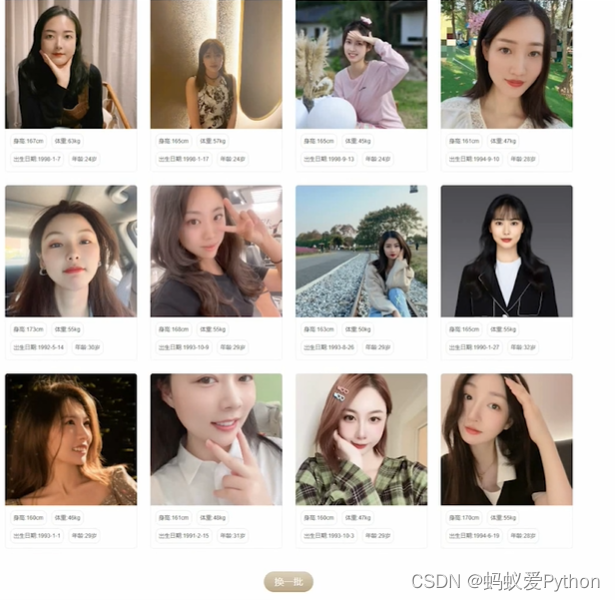

img_content = requests.get(url=img_url, headers=headers).content with open('data\\' + new_name + '.jpg', mode='wb') as img: img.write(img_content) print(dit)效果展示:

源码、资料电子书点击这里

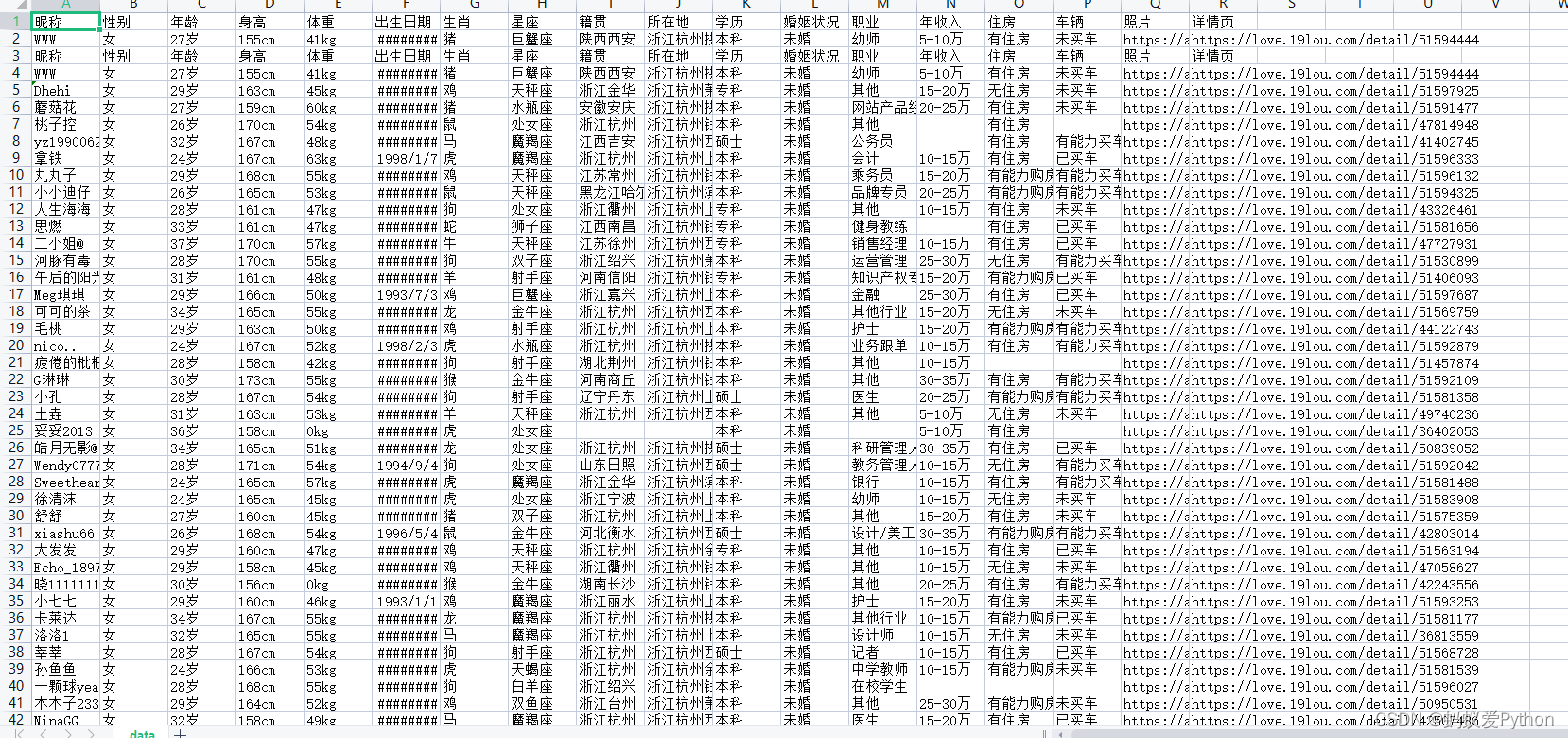

整理成表:

登录后可发表评论

点击登录