免责声明:文章仅供学习使用!

1. 需求

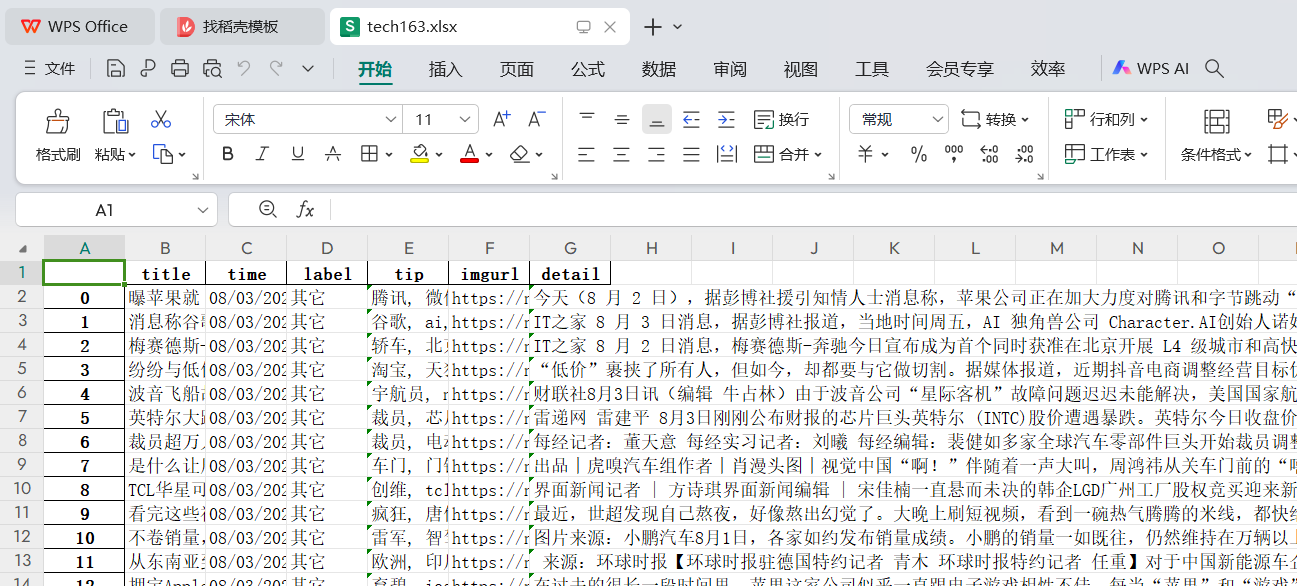

从网易新闻的科技模块爬取今日热点的列表数据,其中包括标题、图片、标签、发表时间、路径、详细文本内容,最后导出这些列表数据到Excel中。

网易科技新闻网址:https://tech.163.com

2. 解决步骤

2.1 前期准备

爬虫脚本中需要引用的Python库:

requests:一个HTTP客户端库,专门用于发送HTTP请求;BeautifulSoup:可以从HTML或XML文件中提取数据;pandas:用于数据分析的一个强大库,这里主要用于整理数据、导出Excel。json:python的一个内置库,用于处理JSON格式的数据。注意:

在执行Python爬虫脚本之前需要引入库,如:

pip install requests

pip install beautifulsoup4

否则会报错(Couldn‘t find ....... you requested: XXX库.)。

2.2 爬取列表基础信息

(1)通过简单脚本爬取页面信息:先爬取网易新闻(https://tech.163.com)的页面信息,看是否有今日热点列表数据。

import requestsurl = 'http://tech.163.com/'response = requests.get(url) # 发送HTTP GET请求 print(response.text) # 打印网页内容可以在控制台看到打印的页面信息。(该打印信息在步骤(3)中会使用到)

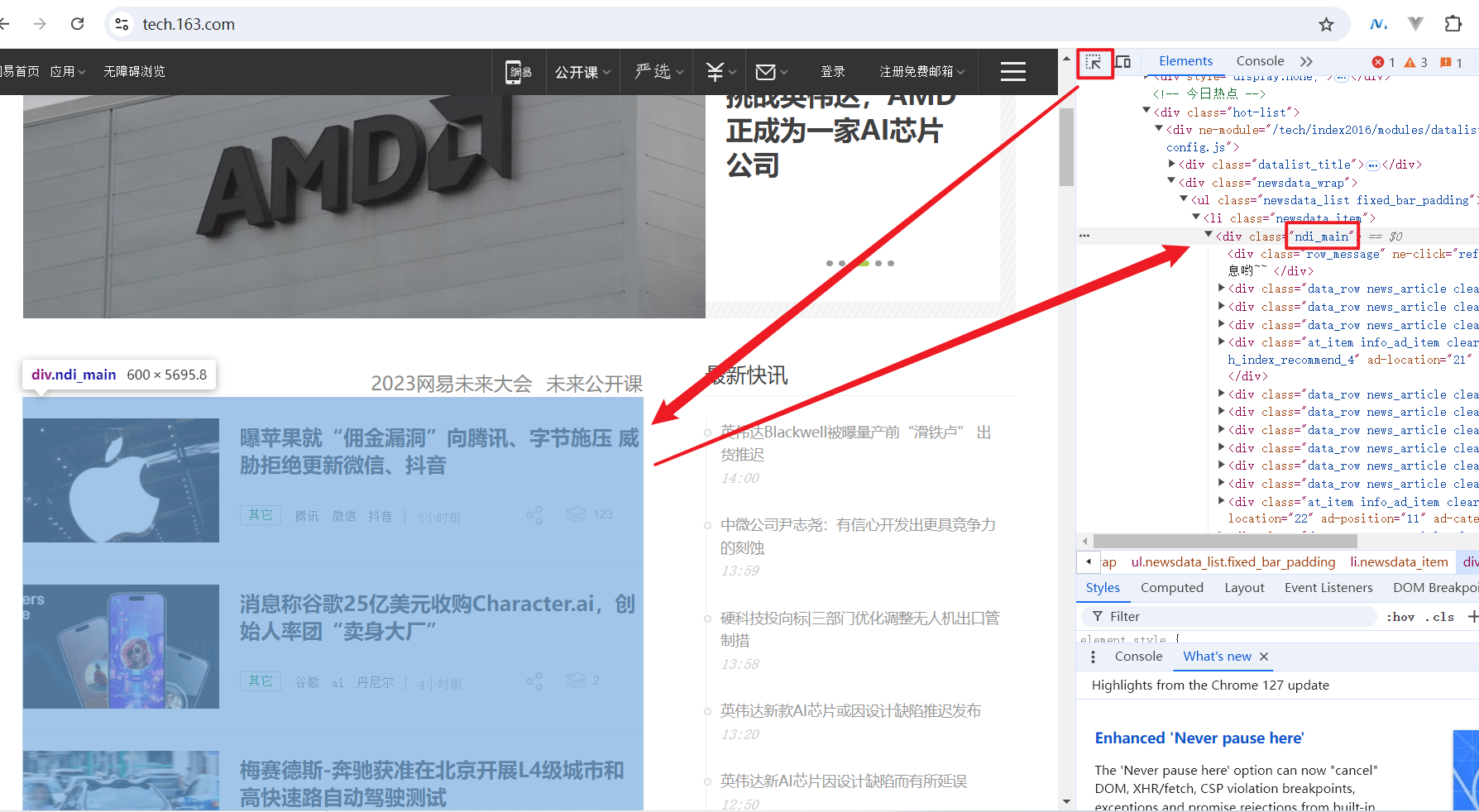

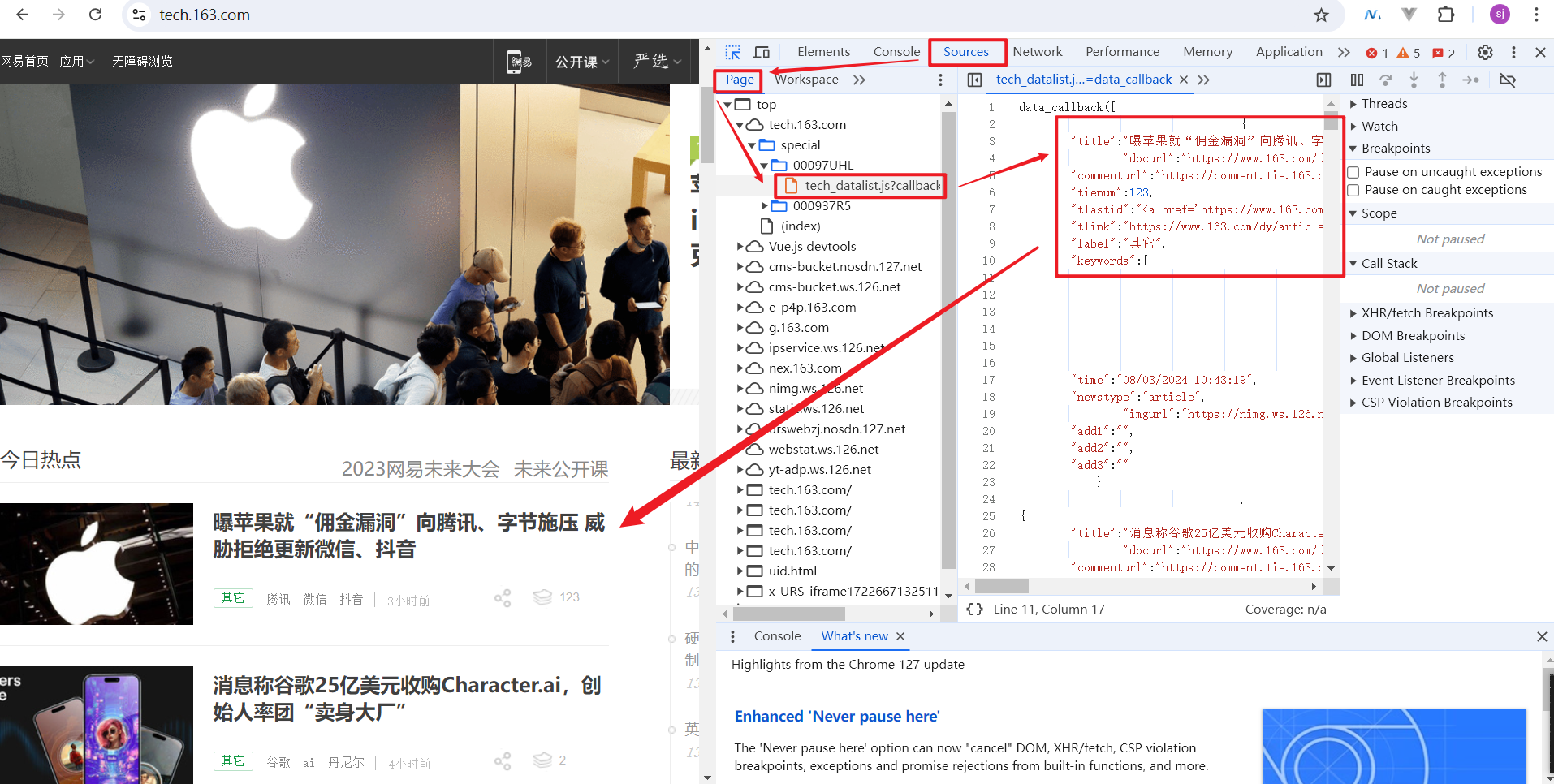

(2)查看列表所在的模块位置:在网易科技新闻页面,键盘按【F12】弹出开发者工具,通过开发者工具左上角的小箭头在页面定位今日热点列表的位置,根据操作可知列表所在div元素的class属性为 “ndi_main” 。

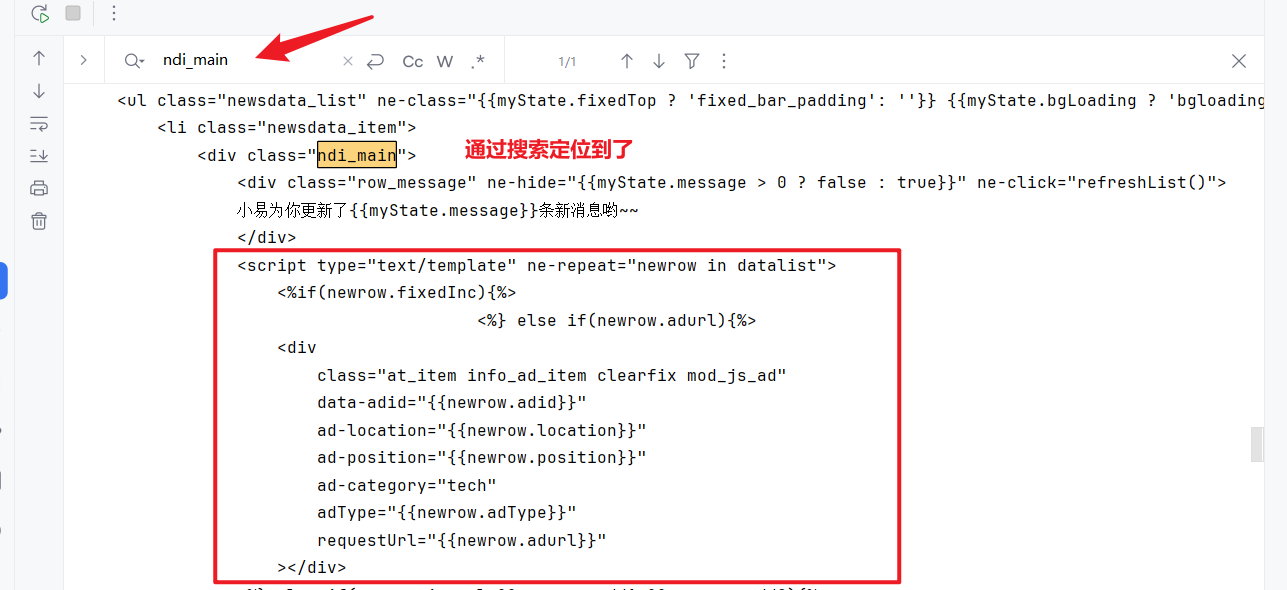

(3)通过打印的页面信息,查看其中是否能获取列表数据:复制div元素的class属性的值 “ndi_main” 到之前打印的页面信息中查看位置。从图中可知今日热点列表的数据是动态加载的。

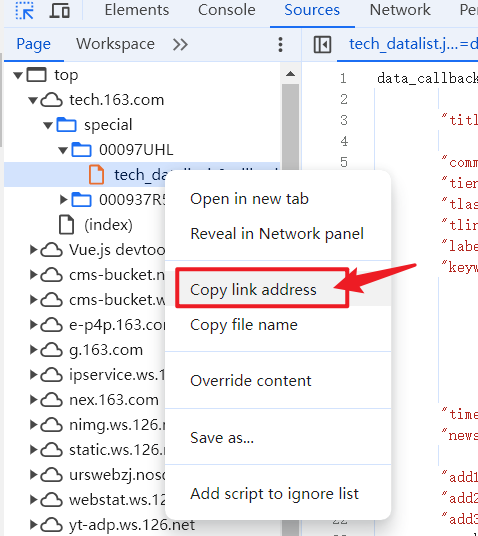

(4)从资源文件获取今日热点列表数据链接地址:从开发者工具的【Source --> Page】加载的文件中查找到今日热点列表的数据是从这个JSON文件获取的。

选择该JSON文件地址,鼠标右键,点击【Copy link address】复制链接地址。

(5)整理获取列表脚本:

import requestsimport json# 今日热点的JSON数据链接地址url = "https://tech.163.com/special/00097UHL/tech_datalist.js?callback=data_callback"# 发送HTTP GET请求response = requests.get(url) # 处理字符串成JSON格式的字符串str = response.text.replace(')', '').replace('data_callback(', '')# 将JSON格式的字符串转换为Python对象json_data = json.loads(str)for i in json_data: title = i["title"] docurl = i["docurl"] imgurl = i["imgurl"] time = i["time"] label = i["label"] tip = '' for j in i["keywords"]: tip += j["keyname"] + ', ' print("标题:" + title) print("发表时间:" + time) print("类型:" + label) print("标识:" + tip) print("路径:" + docurl) print("图片地址:" + imgurl) print("----------------------------------------")打印结果:

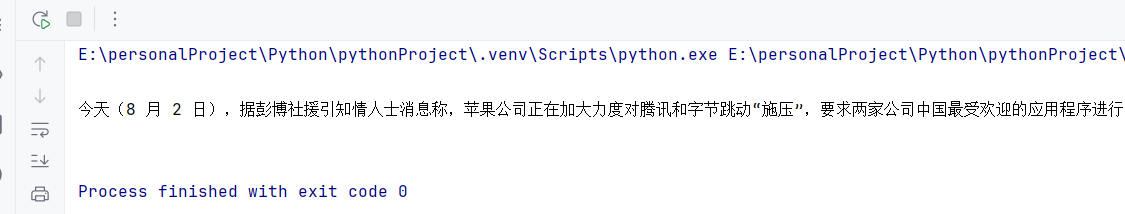

2.3 爬取详情信息

根据第一条新闻路径获取详情信息

import requestsimport jsonfrom bs4 import BeautifulSoup# 详情地址detailUrl = 'https://www.163.com/dy/article/J8K51SIR0519QIKK.html'# headers可取固定值,访问所有详情页均可用headers = {'User-Agent': "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/127.0.0.0 Safari/537.36"}# 发送HTTP GET请求页面信息。注意这里不带请求头无权限获取详情数据信息。response = requests.get(url=detailUrl, headers=headers)# 从HTML文件中提取数据soup = BeautifulSoup(response.text, 'html.parser')# 获取class为“post_body”元素内部的文字内容(无图)text = soup.select('.post_body')[0].textprint(text)打印结果:

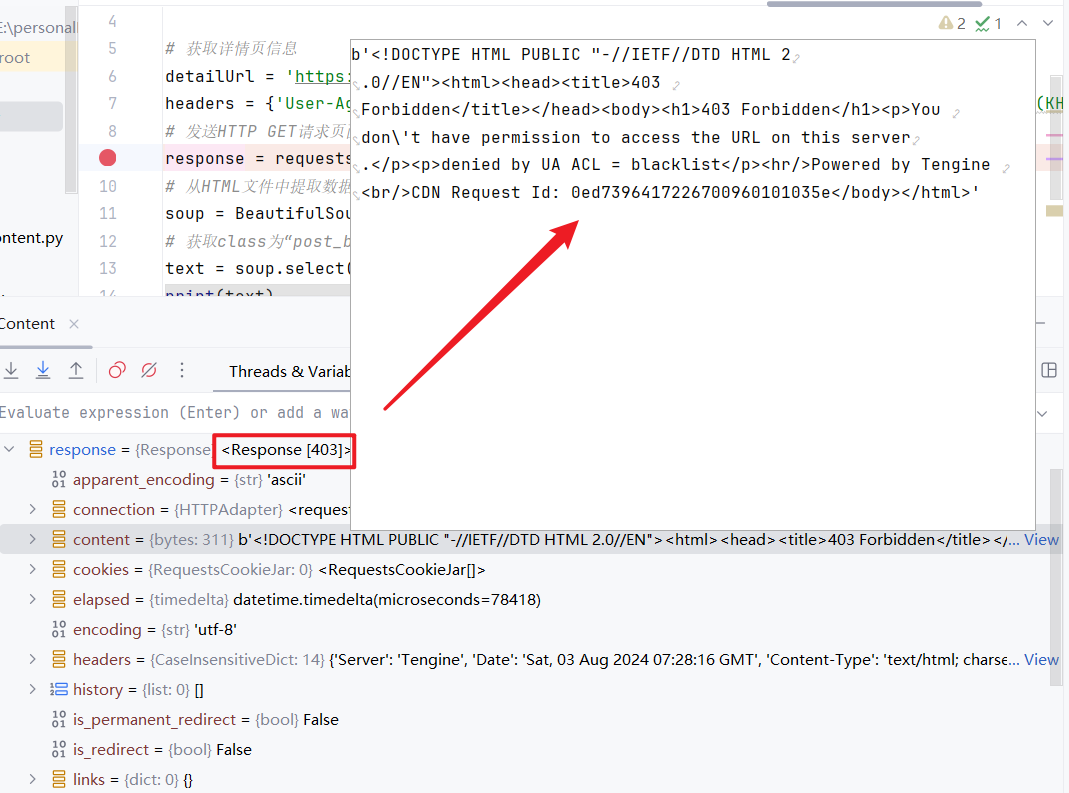

需要注意以下几点:

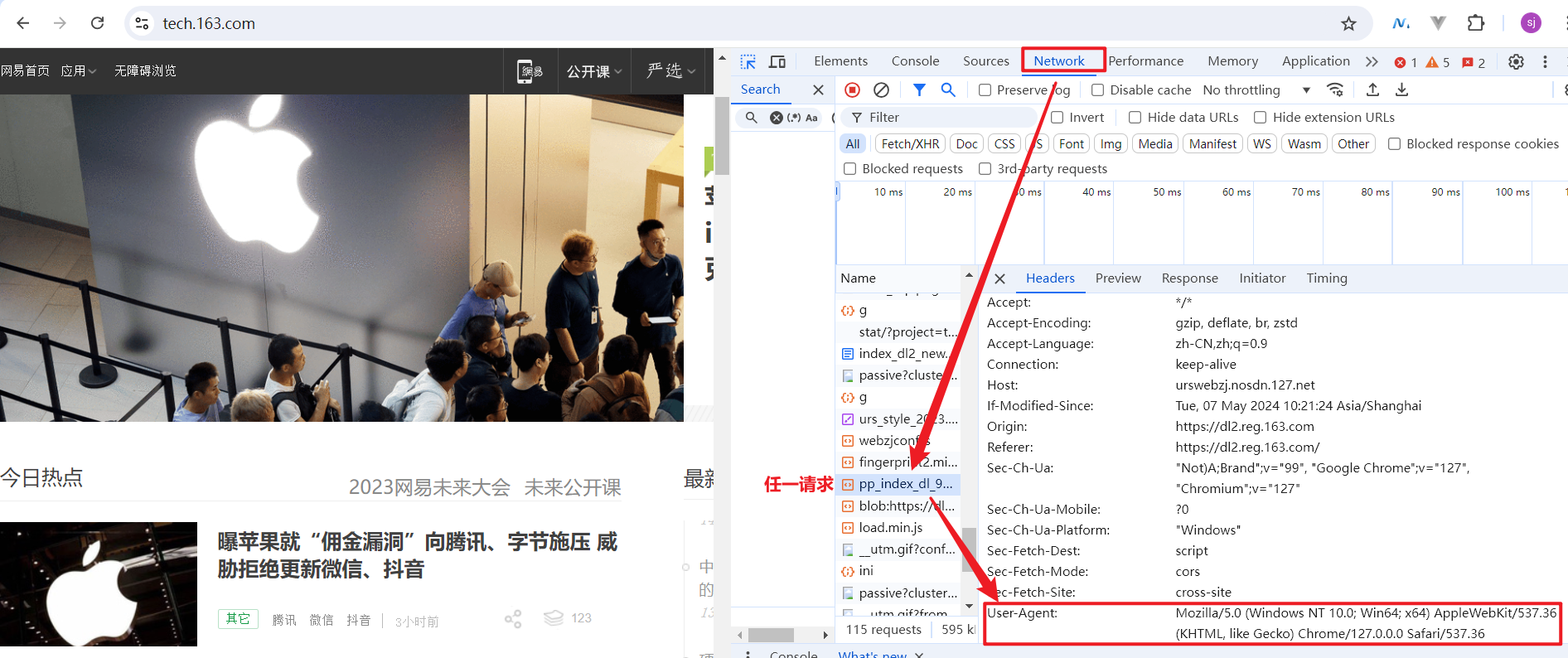

(1)HTTP请求不带请求头,则无权限访问。

headers的值可从任一请求的请求头中获取即可。

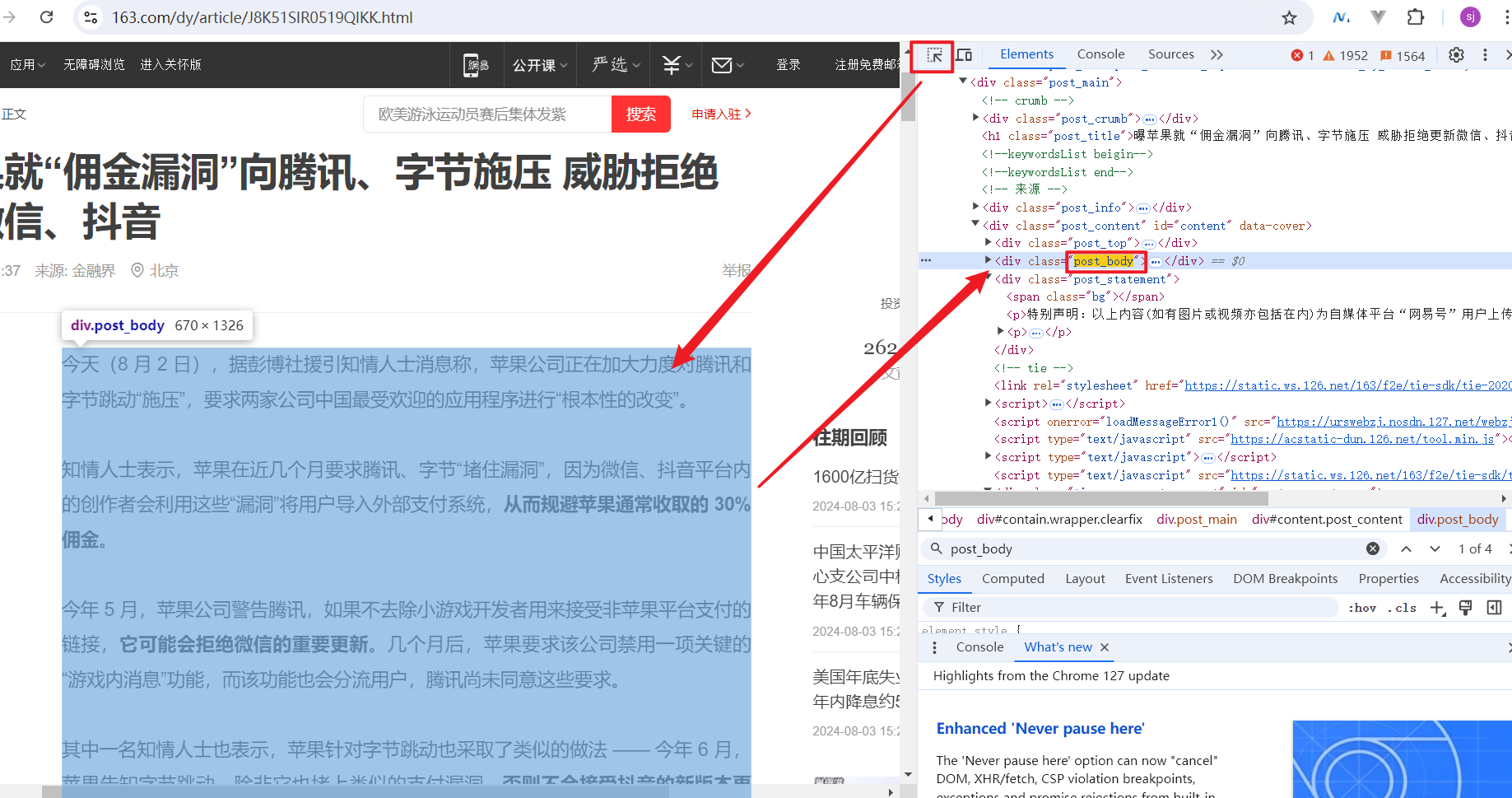

(2)代码中倒数第二行的 “.post_body” 是通过开发者工具左上角的小标签去快速定位详情内容的位置中获取。

2.4 导出数据到Excel中

导出的时候需要使用到pandas库

import pandasdf = pandas.DataFrame(list_res)df.head(5)df.to_excel("tech163.xlsx")print("导出成功")3. 爬虫脚本整理

根据解决步骤,最终整理的爬取网页新闻的脚本如下:

import requestsimport jsonfrom bs4 import BeautifulSoupimport pandas# 网易科技新闻地址url = "https://tech.163.com/special/00097UHL/tech_datalist.js?callback=data_callback"# 获取今日热点列表信息def getNewsList(url): list_res = [] response = requests.get(url) str = response.text.replace(')', '').replace('data_callback(', '') json_data = json.loads(str) for i in json_data: result = {} tip = '' for j in i["keywords"]: tip += j["keyname"] + ', ' result['title']=i["title"] result['time']= i["time"] result['label'] = i["label"] result['tip'] =tip result['imgurl'] =i["imgurl"] result['detail']= getNewsDetail(i["docurl"]) list_res.append(result) df = pandas.DataFrame(list_res) df.head(5) df.to_excel("tech163.xlsx") print("导出成功")# 获取详情信息def getNewsDetail(detailUrl): headers = {'User-Agent': "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/127.0.0.0 Safari/537.36"} response = requests.get(url=detailUrl, headers=headers) soup = BeautifulSoup(response.text, 'html.parser') text = soup.select('.post_body')[0].text return text# 调用接口进行验证getNewsList(url)导出的Excel文件内容如下: