ollama+ollama-webu在windos上部署的教程

一、需要准备的环境和代码二、开始部署1. 修改系统变量: 常见问题

首先介绍一下ollama:

Ollama 是一种为快速大规模语言模型推理所设计的框架和平台。它旨在帮助用户通过高效的方式运行和管理大型语言模型,支持在不同硬件环境中进行优化计算。Ollama 可以利用各种硬件加速器(如 GPU 和 TPU),并通过分布式计算框架实现快速的推理和训练。

其主要特点包括:

一、需要准备的环境和代码

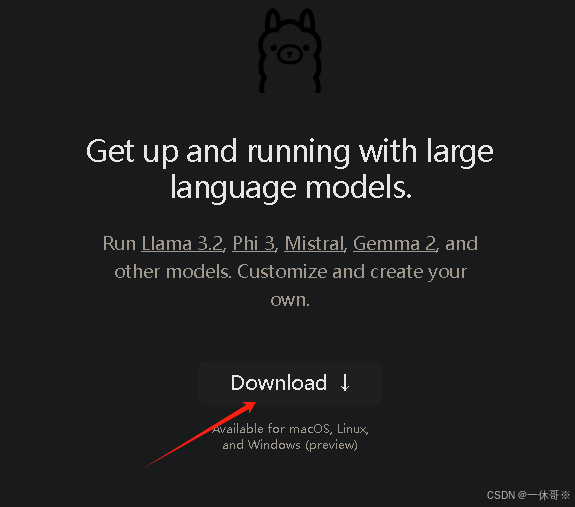

ollama.exe下载:https://ollama.com/

ollamawebui代码下载:git clone https://github.com/ollama-webui/ollama-webui-lite

二、开始部署

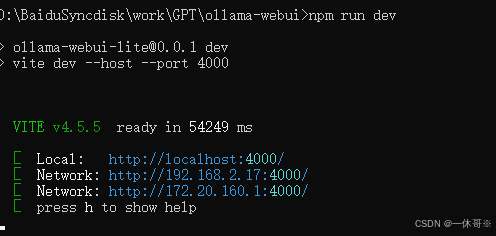

下载并安装 Node.js 工具:https://nodejs.org/zh-cn下载ollama-webui工程代码:git clone https://github.com/ollama-webui/ollama-webui-lite ollama-webui切换ollama-webui代码的目录:cd ollama-webui设置 Node.js 工具包镜像源(下载提速):npm config set registry http://mirrors.cloud.tencent.com/npm/初始化npm:npm init -f安装 Node.js 依赖的工具包:npm install最后,启动 Web 可视化界面:npm run dev到这里就会出现几个网站:

打开http://localhost:4000/

就可以进行使用了,

1. 修改系统变量:

打开cmd,设置模型下载的位置,ollama的接收端口,设置完以下后都要重启一下ollama,或者重启电脑

# 永久指定setx OLLAMA_MODELS "D:\Ollama\Models"# 临时指定set OLLAMA_MODELS="D:\Ollama\Models"setx OLLAMA_HOST "0.0.0.0"setx OLLAMA_ORIGINS "*"# 查看环境变量echo %OLLAMA_ORIGINS%○ OLLAMA_MODELS:可以定义Ollama下载模型的位置

ollama常用的设置环境变量

OLLAMA_MODELS:模型文件存放目录,默认目录为当前用户目录(Windows 目录:C:\Users%username%.ollama\models,MacOS 目录:~/.ollama/models,Linux 目录:/usr/share/ollama/.ollama/models),如果是 Windows 系统建议修改(如:D:),避免 C 盘空间吃紧OLLAMA_HOST:Ollama 服务监听的网络地址,默认为127.0.0.1,如果允许其他电脑访问 Ollama(如:局域网中的其他电脑),建议设置成0.0.0.0,从而允许其他网络访问OLLAMA_PORT:Ollama 服务监听的默认端口,默认为11434,如果端口有冲突,可以修改设置成其他端口(如:8080等)OLLAMA_ORIGINS:HTTP 客户端请求来源,半角逗号分隔列表,若本地使用无严格要求,可以设置成星号,代表不受限制OLLAMA_KEEP_ALIVE:大模型加载到内存中后的存活时间,默认为5m即 5 分钟(如:纯数字如 300 代表 300 秒,0 代表处理请求响应后立即卸载模型,任何负数则表示一直存活);我们可设置成24h,即模型在内存中保持 24 小时,提高访问速度OLLAMA_NUM_PARALLEL:请求处理并发数量,默认为1,即单并发串行处理请求,可根据实际情况进行调整OLLAMA_MAX_QUEUE:请求队列长度,默认值为512,可以根据情况设置,超过队列长度请求被抛弃OLLAMA_DEBUG:输出 Debug 日志标识,应用研发阶段可以设置成1,即输出详细日志信息,便于排查问题OLLAMA_MAX_LOADED_MODELS:最多同时加载到内存中模型的数量,默认为1,即只能有 1 个模型在内存中常见问题

Windows系统,提示错误 Error:Could not connect to ollama app, is it running

说明没有正确启动,1. 重新启动电脑,再次尝试。2. 关闭ollama程序,以管理员身份重新启动ollama