引言

随着人工智能技术的飞速发展,大型语言模型(Large Language Models, LLMs)已成为自然语言处理领域的研究热点。Ollama是一个强大的工具,它使得在本地部署和管理这些大型语言模型变得更加便捷。本文档旨在指导Java开发者如何在Java应用程序中调用基于Ollama部署的本地大型语言模型,实现文本生成、问答、文本分类等多种自然语言处理任务。

环境准备

安装Ollama和模型加载: 该内容已经在之间文档进行说明,这里不再赘述,读者可以查看之前的文档内容。。Java环境: java我们现在java 17进行开发,因为我们依赖的io.springboot.ai,从查看资料的结果看,需要基于java17或者以上才能进行开发,不然可能在程序启动的时候存在如下报错OllamaChatClient.class

类文件具有错误的版本 61.0, 应为 52.0

请删除该文件或确保该文件位于正确的类路径子目录中。

Java调用Ollama

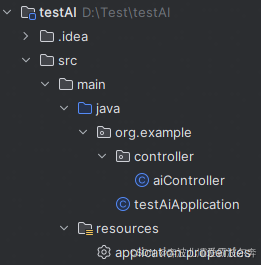

我们通过基于一个SpringBoot和Maven方式并且通过接口展示的方式进行举例,我们程序代码的结果如下

1. pom.xml设置

我们设置我们的pom.xml中的内容如下

<?xml version="1.0" encoding="UTF-8"?><project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance" xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd"> <modelVersion>4.0.0</modelVersion> <parent> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-parent</artifactId> <version>3.2.5</version> <relativePath/> <!-- lookup parent from repository --> </parent> <groupId>org.example</groupId> <artifactId>testAI</artifactId> <version>1.0-SNAPSHOT</version> <properties> <maven.compiler.source>17</maven.compiler.source> <maven.compiler.target>17</maven.compiler.target> <java.version>17</java.version> <project.build.sourceEncoding>UTF-8</project.build.sourceEncoding> </properties> <dependencies> <dependency> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-web</artifactId> </dependency> <dependency> <groupId>io.springboot.ai</groupId> <artifactId>spring-ai-ollama-spring-boot-starter</artifactId> <version>1.0.0</version> </dependency> <dependency> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-devtools</artifactId> <scope>runtime</scope> <optional>true</optional> </dependency> <dependency> <groupId>org.projectlombok</groupId> <artifactId>lombok</artifactId> <optional>true</optional> </dependency> <dependency> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-test</artifactId> <scope>test</scope> </dependency> <dependency> <groupId>org.springframework</groupId> <artifactId>spring-web</artifactId> <version>6.1.6</version> </dependency> </dependencies> <build> <plugins> <plugin> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-maven-plugin</artifactId> <configuration> <excludes> <exclude> <groupId>org.projectlombok</groupId> <artifactId>lombok</artifactId> </exclude> </excludes> </configuration> </plugin> </plugins> </build> <repositories> <repository> <id>spring-milestones</id> <name>Spring Milestones</name> <url>https://repo.spring.io/milestone</url> <snapshots> <enabled>false</enabled> </snapshots> </repository> </repositories></project>2. application.properties设置

我们设置我们的application.properties中的内容如下

server.port=8099

spring.ai.ollama.base-url=http://10.31.128.110:9999

spring.ai.ollama.chat.options.model=Qwen2-7b:latest

其中上述的内容中spring.ai.ollama.base-url为你本地使用ollama搭建的大模型地址,spring.ai.ollama.chat.options.model则是你在文档搭建的大模型名称

3. application启动设置

我们设置testAiApplication主程序启动的代码如下

package org.example;import org.springframework.boot.SpringApplication;import org.springframework.boot.autoconfigure.SpringBootApplication;import org.springframework.scheduling.annotation.EnableAsync;@EnableAsync@SpringBootApplicationpublic class testAiApplication { public static void main(String[] args) { SpringApplication.run(testAiApplication.class, args); }}4. 接口暴露

我们编写aiController暴露对应的接口内容

package org.example.controller;import org.springframework.ai.ollama.OllamaChatClient;import org.springframework.beans.factory.annotation.Autowired;import org.springframework.beans.factory.annotation.Qualifier;import org.springframework.web.bind.annotation.GetMapping;import org.springframework.web.bind.annotation.RequestParam;import org.springframework.web.bind.annotation.RestController;@RestControllerpublic class aiController { @Autowired @Qualifier("ollamaChatClient") private OllamaChatClient ollamaChatClient; @GetMapping("/ollama/chat/v1") public String ollamaChat(@RequestParam String msg) { return this.ollamaChatClient.call(msg); }}5. 程序启动

编写好对应的代码以后,我们可以启动我们的程序

2024-09-18T15:10:34.292+08:00 INFO 16896 — [ restartedMain] o.s.b.w.embedded.tomcat.TomcatWebServer : Tomcat started on port 8099 (http) with context path ‘’

2024-09-18T15:10:34.328+08:00 INFO 16896 — [ restartedMain] org.example.testAiApplication : Started testAiApplication in 7.331 seconds (process running for 8.44)

6. 测试验证

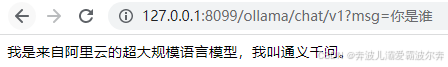

通过上述代码我们可以知道,我们暴露的接口是/ollama/chat/v1,我们打开浏览器,测试对应的接口信息,调用接口如下:http://127.0.0.1:8099/ollama/chat/v1?msg=你是谁

我们可以得到大模型返回的结果如下:

注意事项

● 安全性: 考虑到API可能暴露在公网,务必采取适当的安全措施,如使用HTTPS、API密钥验证等。

● 资源管理: 大型语言模型运行时消耗大量计算资源。监控和限制并发请求,避免资源耗尽。

● 错误处理: 实际应用中要增加异常处理逻辑,确保程序健壮性。

结语

通过上述步骤,你可以在Java应用程序中无缝集成基于Ollama的本地大型语言模型,为你的项目增添强大的自然语言处理能力。随着Ollama及其支持的模型不断更新,持续探索和优化模型调用策略,将能进一步提升应用性能和用户体验。