1.python环境准备

注:llama-cpp-python安装一定要带上前面的参数安装,如果仅用pip install装,启动服务时并没将模型加载到GPU里面。

# CMAKE_ARGS="-DLLAMA_METAL=on" FORCE_CMAKE=1 pip install llama-cpp-pythonCMAKE_ARGS="-DLLAMA_CUBLAS=on" FORCE_CMAKE=1 pip install llama-cpp-pythonpip install uvicornpip install starlettepip install fastapipip install sse_starlettepip install starlette_contextpip install pydantic_settings2.llama-cpp-python安装报错

报错踩坑1:

安装llama-cpp-python过程出现报错

CMake Error at vendor/llama.Cpp/CMakeLists.txt:186 (find library):

Could not find FOUNDATION LIBRARY using the followingnames: Foundation

解决方法1:

网上找到采用离线安装到方式,可以成功安装,但是高兴得太早了。

wget https://github.com/abetlen/llama-cpp-python/releases/download/v0.2.56/llama_cpp_python-0.2.56-cp311-cp311-manylinux_2_17_x86_64.whlpip install llama_cpp_python-0.2.56-cp311-cp311-manylinux_2_17_x86_64.whl# 参考链接:https://blog.csdn.net/qq_38463737/article/details/136477026坑1:

虽然可以成功安装,但是启动llama服务的时候,没法用到GPU加速。

报错踩坑2:

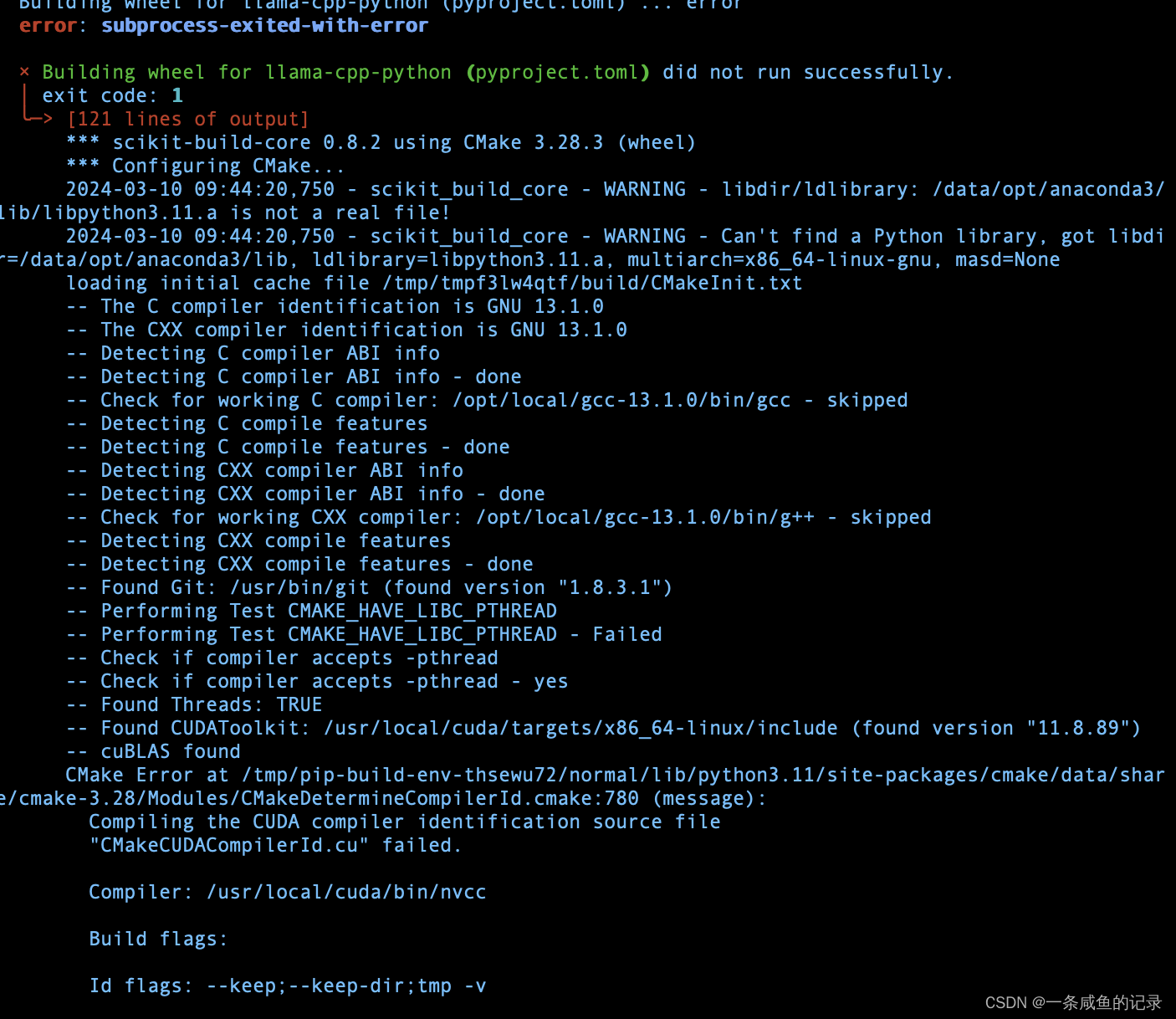

倒腾了很久,看报错一直是cmake对问题,寻思着可能是gcc版本的问题,将gcc升级到13.1。但还是出现报错:

CMake Error at vendor/llama.Cpp/CMakeLists.txt:186 (find library):

Could not find FOUNDATION LIBRARY using the followingnames: Foundation

或者其他诸如的报错【报错太多,没法全记录下来】

CMake configuration failed

看上面的报错Compiling the CUDA compiler identification source file “CMakeCUDACompilerId.cu” failed。感觉像是cuda跟gcc版本的不兼容问题。

解决方法2:

捣鼓了很久,后来参考了一些成功安装的经验,最后选择gcc-9.4.0版本

附带一下gcc版本安装步骤:

## 安装tar xf gcc-9.4.0.tar.xzcd gcc-9.4.0/./contrib/download_prerequisitesmkdir build && cd build../configure --prefix=/usr/local/gcc-9.4.0 --enable-bootstrap --enable-checking=release --enable-languages=c,c++ --disable-multilibmake -j16 # 我这里服务器是16核,这里根据服务器核数修改并行度。make install ## 配置环境变量export GCC_ME_HOME=/usr/local/gcc-9.4.0/PATH=$GCC_ME_HOME/bin:/usr/local/bin:$PATHexport PATHLD_LIBRARY_PATH=$GCC_ME_HOME/lib:$GCC_ME_HOME/lib64:/usr/local/lib:/usr/local/lib64:/usr/lib64:/lib64:$LD_LIBRARY_PATHexport LD_LIBRARY_PATHexport CC=$GCC_ME_HOME/bin/gccexport CXX=$GCC_ME_HOME/bin/g++报错踩坑2:

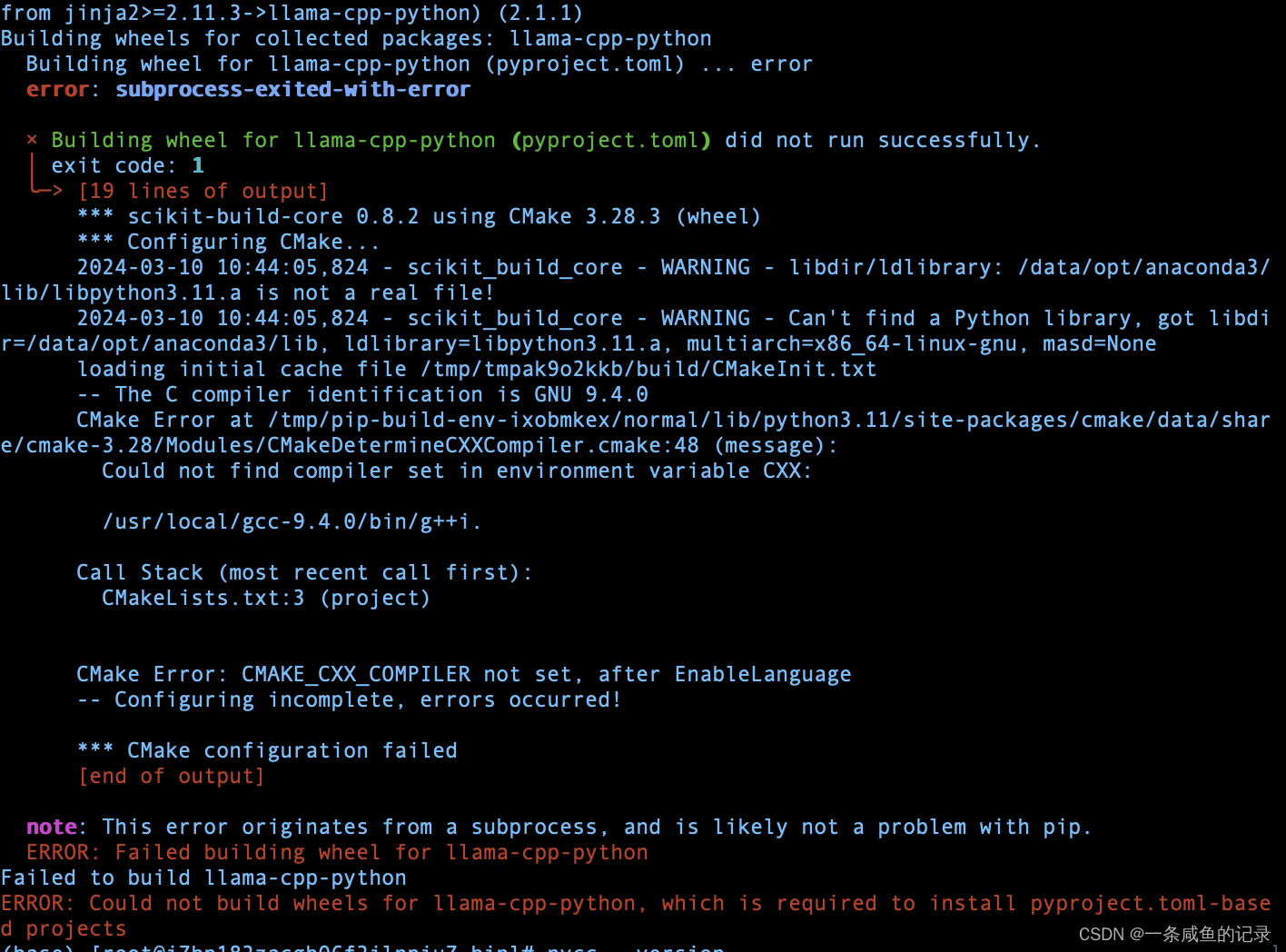

后来还遇到这个问题

Could not find compiler set in environment variable CXX:

估摸着应该是CXX变量没加载的原因,重新加载环境变量,安装。

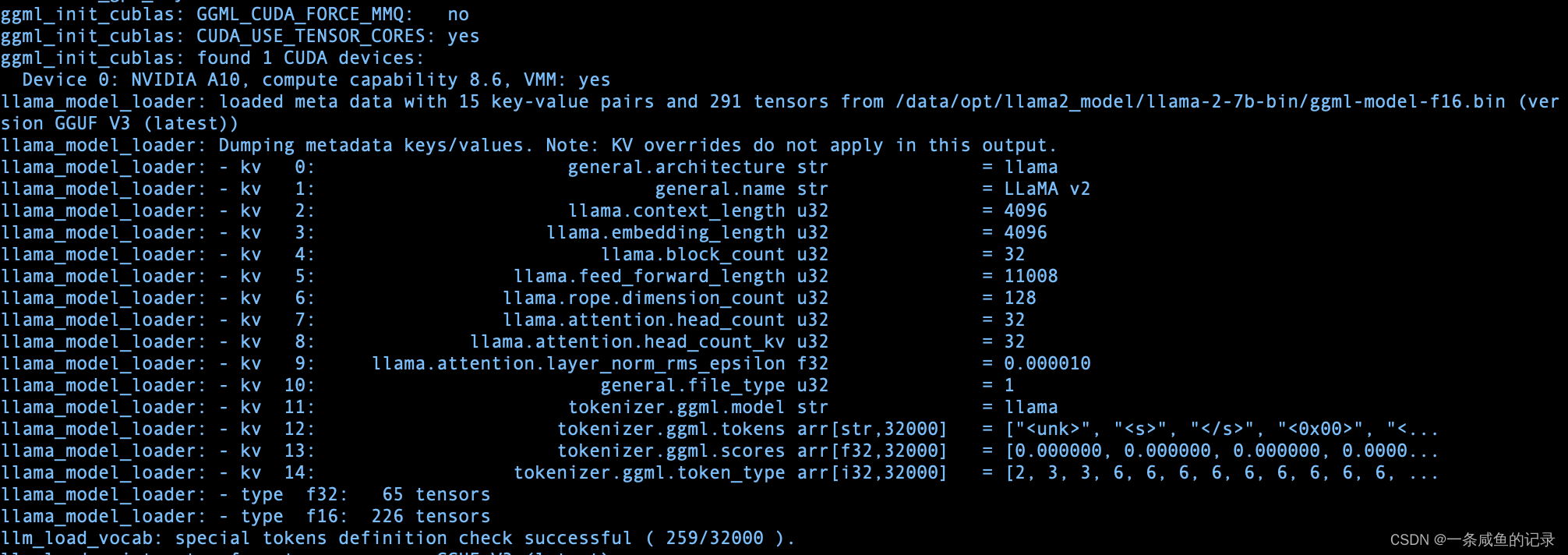

3.服务启动

python3 -m llama_cpp.server --model /data/opt/llama2_model/llama-2-7b-bin/ggml-model-f16.bin --n_threads 30 --n_gpu_layers 200

终于加载到GPU里面!

4.总结

当前环境各组件版本:

gcc:9.4.0cuda:11.8python:3.11.4llama_cpp_python:0.2.56以上,End